Понятие информации

Термин «информация» происходит от латинского слова informatio, означающего разъяснение, изложение, осведомленность.

Информация — сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые воспринимают информационные системы (живые организмы, управляющие машины и др.) в процессе жизнедеятельности и работы.

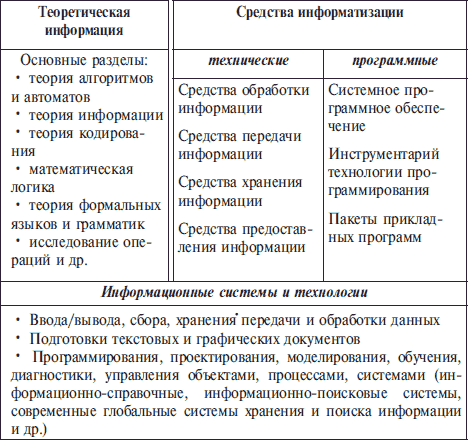

Обработка информации — получение одних информационных объектов из других информационных объектов путем выполнения некоторых алгоритмов.

Средства обработки информации — это разнообразные устройства и системы, созданные для преобразования информации, и в первую очередь, компьютер — универсальная машина для обработки информации.

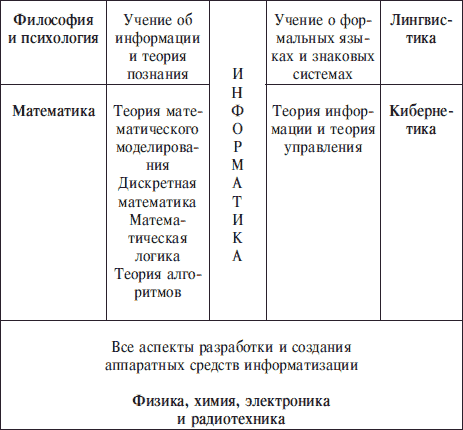

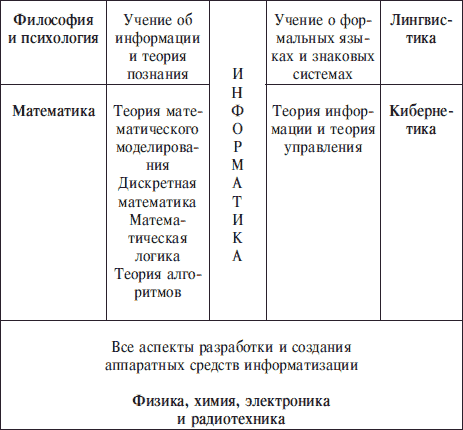

Как комплексная научная дисциплина информатика связана (рис. 1.5):

• с философией и психологией – через учение об информации и теорию познания;

• с математикой – через теорию математического моделирования, дискретную математику, математическую логику и теорию алгоритмов;

• с лингвистикой – через учение о формальных языках и о знаковых системах;

• с кибернетикой – через теорию информации и теорию управления;

• с физикой и химией, электроникой и радиотехникой – через «материальную» часть компьютера и информационных систем.

Представление информации,языки, кодирование

Под словом «кодирование» понимают процесс представления информации, удобный для ее хранения и/или передачи. Следовательно, запись текста на естественном языке можно рассматривать как способ кодирования речи с помощью графических элементов (букв, иероглифов). Записанный текст является кодом, заключающим в себе содержание речи, т. е. информацию.

Процесс чтения текста — это обратный по отношению к письму процесс, при котором письменный текст преобразуется в устную речь. Чтение можно назвать декодированием письменного текста.

Существует множество способов кодирования. Например, стенография — быстрый способ записи устной речи. Ею владеют лишь немногие специально обученные люди — стенографисты. Они успевают записывать текст синхронно с речью выступающего человека. В стенограмме один значок обозначает целое слово или сочетание букв.

Для кодирования одной и той же информации могут быть использованы разные способы; их выбор зависит от ряда обстоятельств: цели кодирования, условий, имеющихся средств.

Выбор способа кодирования информации может быть связан с предполагаемым способом ее обработки.

В некоторых случаях возникает потребность засекречивания текста сообщения или документа, для того чтобы его не смогли прочитать те, кому не положено. Это называется защитой от несанкционированного доступа. В таком случае секретный текст шифруется. В давние времена шифрование называлось тайнописью. Шифрование представляет собой процесс превращения открытого текста в зашифрованный, а дешифрование -процесс обратного преобразования, при котором восстанавливается исходный текст. Шифрование — это тоже кодирование, но с засекреченным методом, известным только источнику и адресату. Методами шифрования занимается наука криптография.

Измерение информации. Объемный подход

Объем информации не связан с ее содержанием. Когда говорят об объеме информации, то имеют в виду размер текста в том алфавите, с помощью которого эта информация представлена. В компьютерах используется двоичное кодирование информации. Для двоичного представления текстов в компьютере чаще всего используется равномерный восьмиразрядный код. С его помощью можно закодировать алфавит из 256 символов, поскольку 256 = 2 8.

Объём информации в электронном сообщении В двоичном коде один двоичный разряд несет одну единицу информации, которая называется 1 бит.

Измерение информации объемный подход На бумажных носителях На цифровых носителях и в технических системах передачи информации

Объем текста измеряется в знаках. Объем информации равен длине двоичного кода. Основная единица: 1 бит один разряд двоичного кода Длина кода символа (i бит) кодируемого алфавита мощностью N символов: 2' = N Информационный объем текста (I), содержащего К символов: I = К-1

Производные единицы:

1 бит - минимальная единица измерения количества информации.

Проблема измерения информации исследована в теории информации, основатель которой - Клод Шеннон.

Информация – это знания человека. Сообщение несет информацию для человека (информативно), если содержащиеся в нем сведения являются для него новыми и понятными.

Можно различить две ситуации: «нет информации» - «есть информация» т.е. количество информации равно нулю или не равно нулю). Нужна единица измерения, тогда можно определить, в каком сообщении информации больше, в каком – меньше. Эта единица называется бит.

Сообщение, уменьшающее неопределенность знаний в два раза, несет 1 бит информации. Неопределенность знаний о некотором событии – это количество возможных результатов события.

Количество информации i, содержащееся в сообщении о том, что произошло одно из N равновероятных событий, можно определить из формулы Хартли: N=2i.

Данная формула является показательным уравнением относительно неизвестного i.

Термин «информация» происходит от латинского слова informatio, означающего разъяснение, изложение, осведомленность.

Информация — сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые воспринимают информационные системы (живые организмы, управляющие машины и др.) в процессе жизнедеятельности и работы.

Обработка информации — получение одних информационных объектов из других информационных объектов путем выполнения некоторых алгоритмов.

Средства обработки информации — это разнообразные устройства и системы, созданные для преобразования информации, и в первую очередь, компьютер — универсальная машина для обработки информации.

Как комплексная научная дисциплина информатика связана (рис. 1.5):

• с философией и психологией – через учение об информации и теорию познания;

• с математикой – через теорию математического моделирования, дискретную математику, математическую логику и теорию алгоритмов;

• с лингвистикой – через учение о формальных языках и о знаковых системах;

• с кибернетикой – через теорию информации и теорию управления;

• с физикой и химией, электроникой и радиотехникой – через «материальную» часть компьютера и информационных систем.

Представление информации,языки, кодирование

Под словом «кодирование» понимают процесс представления информации, удобный для ее хранения и/или передачи. Следовательно, запись текста на естественном языке можно рассматривать как способ кодирования речи с помощью графических элементов (букв, иероглифов). Записанный текст является кодом, заключающим в себе содержание речи, т. е. информацию.

Процесс чтения текста — это обратный по отношению к письму процесс, при котором письменный текст преобразуется в устную речь. Чтение можно назвать декодированием письменного текста.

Существует множество способов кодирования. Например, стенография — быстрый способ записи устной речи. Ею владеют лишь немногие специально обученные люди — стенографисты. Они успевают записывать текст синхронно с речью выступающего человека. В стенограмме один значок обозначает целое слово или сочетание букв.

Для кодирования одной и той же информации могут быть использованы разные способы; их выбор зависит от ряда обстоятельств: цели кодирования, условий, имеющихся средств.

Выбор способа кодирования информации может быть связан с предполагаемым способом ее обработки.

В некоторых случаях возникает потребность засекречивания текста сообщения или документа, для того чтобы его не смогли прочитать те, кому не положено. Это называется защитой от несанкционированного доступа. В таком случае секретный текст шифруется. В давние времена шифрование называлось тайнописью. Шифрование представляет собой процесс превращения открытого текста в зашифрованный, а дешифрование -процесс обратного преобразования, при котором восстанавливается исходный текст. Шифрование — это тоже кодирование, но с засекреченным методом, известным только источнику и адресату. Методами шифрования занимается наука криптография.

Измерение информации. Объемный подход

Объем информации не связан с ее содержанием. Когда говорят об объеме информации, то имеют в виду размер текста в том алфавите, с помощью которого эта информация представлена. В компьютерах используется двоичное кодирование информации. Для двоичного представления текстов в компьютере чаще всего используется равномерный восьмиразрядный код. С его помощью можно закодировать алфавит из 256 символов, поскольку 256 = 2 8.

Объём информации в электронном сообщении В двоичном коде один двоичный разряд несет одну единицу информации, которая называется 1 бит.

- 1 байт = 8 битов.

- 1 Кб (килобайт) = 2 10 байт = 1024 байта;

- 1 Мб (мегабайт) = 2 10 Кб = 1024 Кб;

- 1 Гб (гигабайт) = 2 10 Мб = 1024 Мб

Измерение информации объемный подход На бумажных носителях На цифровых носителях и в технических системах передачи информации

Объем текста измеряется в знаках. Объем информации равен длине двоичного кода. Основная единица: 1 бит один разряд двоичного кода Длина кода символа (i бит) кодируемого алфавита мощностью N символов: 2' = N Информационный объем текста (I), содержащего К символов: I = К-1

Производные единицы:

- 1 байт = 8 бит Килобайт (Кб)

- 1 Кб= 1024 байт Мегабайт (Мб)

- 1 Мб = 1024 Кб Гигабайт (Гб)

- 1 Гб = 1024 Мб

1 бит - минимальная единица измерения количества информации.

Проблема измерения информации исследована в теории информации, основатель которой - Клод Шеннон.

Информация – это знания человека. Сообщение несет информацию для человека (информативно), если содержащиеся в нем сведения являются для него новыми и понятными.

Можно различить две ситуации: «нет информации» - «есть информация» т.е. количество информации равно нулю или не равно нулю). Нужна единица измерения, тогда можно определить, в каком сообщении информации больше, в каком – меньше. Эта единица называется бит.

Сообщение, уменьшающее неопределенность знаний в два раза, несет 1 бит информации. Неопределенность знаний о некотором событии – это количество возможных результатов события.

Количество информации i, содержащееся в сообщении о том, что произошло одно из N равновероятных событий, можно определить из формулы Хартли: N=2i.

Данная формула является показательным уравнением относительно неизвестного i.